黄仁勋对人工智能的6个总结:GPU怎样催化AI计算

雷锋网2016-09-14 00:54:45百度

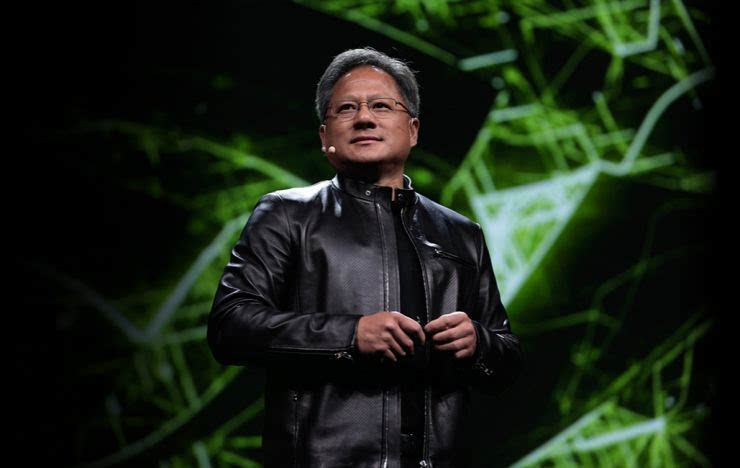

编者按:雷锋网(搜索“雷锋网”公众号关注)2016年9月13日消息,NVIDIA在北京举办了GPU技术大会(GPU Tech Conference),这也是GTC第一次在国内举办。在这次大会上,NVIDIA发布了Tesla P4、P40深度学习芯片,此外黄仁勋也在北京与数以万计的AI、游戏行业的开发者们分享了他对GPU和未来计算的认知。以下内容是根据黄仁勋在GTC China 2016上的演讲实录整理。

一、4年以前,AlexNet第一次带来了深度学习的爆发

2012年一个年轻的研究员叫Alex Krizhevsky。在多伦多大学AI实验室,他设计了一个可以学习的软件,这个软件靠自己就能进行视觉识别。深度学习这个时候已经发展了一段时间,可能有20年。

Alex所设计的这个网络,它有一层一层的神经网络,包括卷积神经网络、激发层、输入和输出,可以进行区分。这样一个神经网络可以学会识别影像或者是规律。深层神经网络所带来的结果是它会非常有效,会超出你的想象,但是它进行训练需要的计算资源超过了现代计算机的能力,它需要几个月的时间去训练一个网络才能真正地识别图像。

Alex当时的看法是,有一个叫做GPU的新型处理器,通过一种叫CUDA的计算模式,可以适用于并行计算,用于非常密集的训练。2012年他当时设计了叫Alex的网络,提交给了一个大规模计算视觉识别大赛,是一个全球的竞赛,并且赢得了这个大赛。

AlexNet战胜了所有由其他计算视觉专家所开发的算法。Alex当时只用两个NVIDIA GTX580,在通过数据训练了几天后,AlexNet的结果和质量引起关注。所有搞计算视觉的科学家,所有的AI科学家都非常关注。在2012年,Alex Krizhevsky启动了计算机深度学习的基础,这是现代AI的一个大爆炸。他的工作和成果在全世界引起了很大反响。

我相信那个时刻会被记住,因为它确实改变了世界。之后有很多研究开始围绕深度学习进行。2012年斯坦福大学的吴教授(吴恩达)和我们开发了一个非常大规模的GPU配置用于深度学习的训练,很快在三年之后每一年都会有新的网络出来,能够不断地战胜其他方案获得更好的记录。

二、声音和视觉输入铺垫了构造AI世界的基础

到了2015年,谷歌和微软都实现了人类般的视觉识别能力。它是由软件写就的,在GPU上经过训练可以实现比人类更高的视觉识别能力。2015年百度也宣布他们的语音识别达到了超越人类的水平,这是非常重要的一个事件。这是第一次计算机能自己写程序,实现超过人类的水平。

视觉和语音是两个非常重要的感官输入,是人类智能的基础。现在我们已经有了一些基础的支柱,让我们能够进一步推进AI的发展,这在之前是难以想象的。如果声音和视觉的输入值不可靠的话,怎么能够有机器可以去学习,可以有人类一样的行为。我们相信这个基础已经有了,这也是为什么我们认为现在是AI时代的开始。

全世界的研究者都看到了这些结果,现在所有的AI实验室都开始使用GPU跑深度学习,这样他们也可以开始建立未来AI的基础。基本上所有的AI研究者都开始用我们的GPU。

GPU的核心是模拟物理世界,我们用GPU创建虚拟世界用于游戏、设计,用于讲故事,比如制作电影。模拟环境、模拟物理属性、模拟周围所看到的世界,构建虚拟世界的过程如同人类大脑在想象时进行的计算。因为深度学习的发展,使我们的工作进入新的阶段,人工智能。对人类智能的模拟会是我们所做的最重要的工作之一,而且我们对此非常激动。

三、GPU计算渗透到深度学习各个领域

今天也是我们第一次在中国举办GTC大会,这次很大一部分内容会是关于人工智能和深度学习。我们是一个计算公司,SDK对于我们来讲是最重要的产品,GTC是我们最重要的一场盛会。大家可以看一下过去几年的成长,这是非常了不起的增速。

今年GTC有16000名人员参加。下载我们SDK的开发人员增长了3倍,达到了40万开发人员。但最了不起的数字是深度学习开发人员在两年之内有了25倍的增长,现在下载我们的深度神经网络实验室引擎的开发人员已经增长了25倍,下载了5万5千次。

大家到底用它干什么呢?很多都是AI研究人员,他们来自于全球各地,现在所有的实验室都会使用我们的GPU平台来做自己的AI研究,有软件公司、互联网软件提供商,还有互联网公司、汽车公司、政府、医疗成像、财务、制造等公司。现在用GPU深度学习的领域是非常广的,非常了不起的。

四、大脑的运作就像GPU的计算

大家要问为什么AI研究人员选择GPU,Alex他们发现GPU的并行运算实际是非常符合深度学习网络的计算特征。那么进一步来讲,为什么GPU对深度学习来讲是非常适合的工具呢?我想给大家讲一个不是那么严肃的例子说明一下为什么GPU非常重要。

大脑就像一个GPU。比如我让大家想象乒乓球,大家闭上眼睛,你们大脑会形成一个几个人打乒乓球的图像,如果让大家想象功夫熊猫,那么脑子里会出现是类似的功夫熊猫图像。所以我们的大脑在思考时会生成一些图片。反过来,GPU的构架也像大脑一样,它不是由一个处理器进行序列的运算,我们的GPU有上千个处理器,非常小的处理器组合在一起来共同解决问题,这上千个处理器会进行数学计算、互相连接、分享信息,最终能够解决一个很大的问题,就好像是我们的大脑一样。所以说大脑就像GPU,因为大脑可以产生图片,而GPU也像人的大脑一样,所以有可能这种新的计算模式、新的计算模型可以解决虚拟现实的问题,它确实是非常适合GPU的。

深度学习是一种新的计算模式,它会涉及软件的方方面面。深度学习首先要设计一个网络并且对网络进行训练,针对一个网络的训练需要几十亿甚至更多的操作,涉及上百万甚至有更多的数据,通过这些数据对网络进行训练,需要很长的时间。如果没有一个GPU,这个过程可能需要好几个月,但GPU把这个时间压缩到几天内,这也是为什么GPU能够帮助大家更好地解决问题。

五、寻找比摩尔定律进化得更快的计算模式

训练是深度学习的一个基础,这个网络有了之后,你希望运用这个网络来进行预测,进行推理,进行归类,要对一个信息进行推理,比如有几十亿人每天在网上问很多的问题,有可能是图片,文字,语音,将来有可能是视频这种形式。在数据中心当中GPU推理能够非常快地响应。所以深度学习的第一部分是训练,第二部分是推理。

深度学习的第三部分,有些人叫IoT,智能设备、智能终端,也许是摄像头、汽车、机器人,也许是话筒,这样互联设备就变成了智能设备。物联网需要有AI进行驱动,需要深度神经网络进行驱动,大量的智能终端根本目标是需要去识别去归类进行交互,要快要准确,并且尽量在低功耗状态下实现所有这些功能。

在接下来这些时间,软件的开发会和以前不一样,我们运行软件的方法也会不一样,在上面的运算也会不一样,很多设备上要运行什么东西会不一样,所以深度学习将会影响到到计算的各个方面。

现在我们看一下训练,首先我们应该意识到训练的复杂性。前面提到了训练可能是几十亿甚至万亿的运算,模型越大数据越多,结果就会越准确,数据多,加上大模型、大的计算量将会带来深度学习更好的结果,这是非常根本的、非常重要的。

微软有一个叫ResNet的识别网络,如果跟AlexNet比较,AlexNet神经网络是8层,总计算量是1.4G的浮点运算,错误率是16%。8层和1.4G,错误率是16%,意味着什么?这是当时最好的。当时计算视觉专家研发的算法大部分错误率可能比16%更高,这说明用传统计算视觉方式的局限性很大,准确率没有那么高。

如果通过深度学习,我们在过去几年中可以实现3.5%的错误率,3.5%这是在几百万的图像当中进行测试152层的一个网络,几年之前只有8层,现在是152层,总共的计算能力是22.6G/flps,这是18倍的增长,这就表明了深度学习存在的问题。三年之内深度学习的计算负载增长了18倍,这比摩尔定律快很多。

所以问题变得越来越复杂,越来越难,但是计算的能力却没有相应速度的增长,这也是为什么整个行业都开始寻找新的计算模式,为他们都开始来考虑使用GPU计算。

另一个案例更加惊人,是关于语音识别。语音识别是自然语言理解的基础,自然语言理解也是智能的基础。这是百度吴恩达的实验室的工作,2014年有2500万的参数在这个模型当中,训练的材料是7000小时的语料8%的错误率。2015年的训练数据是此前的2倍,深度学习网络是原来的4倍大,2倍的数据量,4倍的网络复杂性,实现的错误率是5%,就在1年之内百度的DPS错误率降至了40%左右。但是需要付出什么样的代价?就是计算量的增长。

深度学习的方法花了这么长的时间才真正出现,因为这样的方法从计算条件来说是没有办法实现的,此前没有任何计算机可以对这样的网络进行训练,直到GPU出现用于深度学习的出现。这是我讲的为什么我们对这样新的计算模式非常振奋,为什么现在在我们这个计算行业当中这个时刻非常重要。

同时这个趋势在未来还会继续,大家要记住我们现在还是5%的错误率,我们希望是0%的错误率。每个人的声音都可以被识别,甚至是做得更好,可以去理解词的语义,所以我们还有很多更大的计算需求。

六、AI会自上而下地改变计算系统

Pascal是我们针对深度学习进行优化的GPU架构。Pascal的处理器是真正的奇迹,Pascal是一个全新的架构,用立体的晶体管制成,用立体的封装,用3D的堆栈,所有这些使得我们的Pascal架构实现了巨大的性能提升,新的指令级和新的制造制成、新的封装方式,以及新的互联连接方式把多个GPU连到一起,这样它们可以做一个团队来开展工作。我们花了3年的时间,1万个人年的投入,完成了这项我们自己史上最大的工作。

我们也认识到处理器还只是开始。在AI计算这块有这样一个新的计算模式,计算系统架构也会发生变化,处理器的设计会发生变化,算法会发生变化,我们开发软件的方式会发生变化,系统的设计也会发生变化。

我们有一个新的超级计算机,在一个盒子的大小之内,这就是叫DGX-1,替代了大约250台服务器,整个数据中心都缩成了一个小盒子的大小。这个超级计算机完全是重新设计的。看一下我们处理器的成就再加上DGX-1,使得我们在一年之内的性能有65倍的提高。相比较这个Alex第一次用我们GPU来训练他的网络的时候,这是65倍的提高。这比摩尔定律的速度要快很多,比整个半导体的发展要快很多,比任何其他的在计算的进步方面要快很多。